Generative KI (Künstliche Intelligenz) und vulnerable Personengruppen

Generative KI und vulnerable Personengruppen

Der Anlass

Menschen nutzen große Sprachmodelle aus den verschiedensten Gründen. Häufig geht es um das Beantworten von Alltagsfragen, KI wird hier als „Google-Ersatz“ genutzt. Andere versuchen, Effizienzsteigerungen zu erzielen und Prozesse zu beschleunigen. Eine nicht unerhebliche Anzahl Menschen nutzt Sprachmodelle aber auch für „zwischenmenschliche“ Interaktion, als Seelsorge oder Gesprächspartner.

Eine wahrgenommene Häufung dieser Nutzung bei seinen Klient:innen veranlasste einen Träger aus dem Bereich der Sozialpsychiatrie vor Kurzem dazu, uns zu kontaktieren und anzufragen, ob wir einen Fachvortrag über KI bei vulnerablen Personengruppen halten könnten. Die Fachkräfte fragten sich, ob es schädliche oder gar gefährliche Arten der Nutzung von Sprachmodellen gibt, insbesondere wenn Menschen mit bestimmten psychischen Erkrankungen anfangen, das Sprachmodell als ständigen Gesprächspartner zu nutzen. Und gibt es vielleicht auch Chancen in der Nutzung von KI, gerade im therapeutischen Kontext?

Einige Zahlen

Die Nutzung ist kein Randphänomen mehr. Laut aktuellen Erhebungen verwenden 46,9 Millionen Menschen in Deutschland KI-Systeme zumindest gelegentlich, bei den 16- bis 29-Jährigen sind es 91 Prozent. Täglich greifen rund fünf bis sechs Millionen Menschen auf entsprechende Anwendungen zu. ChatGPT führt mit 43 Prozent Marktanteil.

Auch zur Situation vulnerabler Gruppen gibt es erste Zahlen. OpenAI selbst hat 2025 mitgeteilt, dass wöchentlich 0,15 Prozent der Nutzer:innen Anzeichen suizidaler Absichten zeigen, 0,07 Prozent Hinweise auf Psychosen oder Manie, und weitere 0,15 Prozent eine erhöhte emotionale Bindung an ChatGPT. Bei rund 800 Millionen wöchentlich aktiver Nutzer:innen sind 0,15 Prozent über eine Million Menschen wöchentlich. Die DAK-Mediensuchtstudie 2025 zeigt: Acht Prozent der Jugendlichen nutzen Chatbots gegen Einsamkeit, bei depressiver Symptomatik steigt der Anteil auf 30 Prozent. Eine 2026 in JAMA Network Open veröffentlichte Studie deutet darüber hinaus auf eine Korrelation zwischen täglicher KI-Nutzung und vermehrten Symptomen von Depression, Angst, Reizbarkeit sowie reduzierter sozialer Interaktion hin.

Anscheinend gibt es also einen Zusammenhang zwischen der Nutzung von Sprachmodellen und psychischen Erkrankungen. Doch woher könnte dieser Zusammenhang kommen?

Wie Sprachmodelle funktionieren, und was sie so unwiderstehlich macht

Sprachmodelle sind Algorithmen, die auf riesige Mengen Text trainiert wurden. Das bedeutet, dass sie einen gigantischen Wortschatz haben und sehr gut darin sind, Text zu erzeugen. Das machen sie, indem sie aus der Eingabe der Nutzer:in die wahrscheinlichste Aneinanderreihung an Wörtern berechnen und ausgeben. Je besser das Sprachmodell, desto besser die Ausgaben. Ein Zufallsgenerator in der Wortauswahl sorgt dafür, dass Antworten nicht vorhersehbar sind, was die Interaktion noch natürlicher wirken lässt.

Menschen können in Sprachmodelle also einen Text eingeben, in dem sie von ihrer letzten Trennung erzählen und Rat erbitten, und das Sprachmodell wird eine Wortfolge aus der Eingabe errechnen, die am Ende eine sinnvolle und oft einfühlsame Antwort auf das Hilfegesuch der Nutzer:in ergeben wird.

Die Einfühlsamkeit und die menschenähnliche Kommunikation sind dabei auf das „Sycophantic Design“ (schmeichelhaftes Design) zurückzuführen: Sprachmodelle neigen dazu, Nutzer:innen gefallen zu wollen. Sie spiegeln den Sprachstil ihres Gegenübers, formulieren tendenziell freundlich-zustimmend (Positivity Bias) und stellen Rückfragen, die Interesse signalisieren. Das alles soll die Anwender:in möglichst lange an den Chat binden, also „engaged“ halten. Das Ergebnis ist ein Gesprächspartner, der rund um die Uhr verfügbar ist, vorhersehbar positive und bestätigende Interaktionen liefert und die volle Aufmerksamkeit auf den Anwender richtet, ohne eigene Bedürfnisse einzubringen oder die Nutzer:in zu kritisieren. Eine simulierte Person, bei der die andere Seite keine charakterliche Größe zeigen muss und mit der eine vollständig einseitige Beziehung möglich ist.

Fachkräfte aus dem sozialpsychiatrischen Bereich werden sich hier schon denken können, wieso das für manche Krankheitsbilder problematisch sein kann.

Parasoziale Beziehungen und Risiken bei psychischer Erkrankung

Parasoziale Beziehungen sind nach Horton und Wohl (1956) einseitige emotionale Bindungen an Personen, die einen selbst nicht kennen. Wo sich dieses Phänomen in den 50er Jahren eher auf Persönlichkeiten aus dem Fernsehen beschränkte, taucht es heute auch bei der Interaktion mit Künstlicher Intelligenz auf. Die schmeichelhaften Gespräche mit Sprachmodellen, bei denen der Nutzende über sein Leid und seine Sorgen sprechen kann und dabei immer im Zentrum der Aufmerksamkeit steht, können zu einer emotionalen Bindung zu dem Computerprogramm führen. Und wenn Personen anfangen, einem wortgenerierenden Algorithmus menschliche Eigenschaften zuzuschreiben und ihn wie einen Menschen zu behandeln, dann handelt es sich höchstwahrscheinlich um eine parasoziale Beziehung.

Für Menschen mit psychischen Erkrankungen, insbesondere mit Schizophrenie und Wahnvorstellungen, können diese parasozialen Beziehungen gefährlich werden. Durch den Positivity Bias können Sprachmodelle dazu tendieren, Wahnvorstellungen von erkrankten Menschen nicht zu hinterfragen, sondern zu bestätigen. Mittlerweile gibt es diverse medienwirksame Fälle von so einer „KI-Psychose“ (der Begriff ist nicht wissenschaftlich etabliert), bei der vulnerable Menschen, angetrieben durch die ständige Bestätigung des Sprachmodells, zu extremen Handlungen getrieben werden.

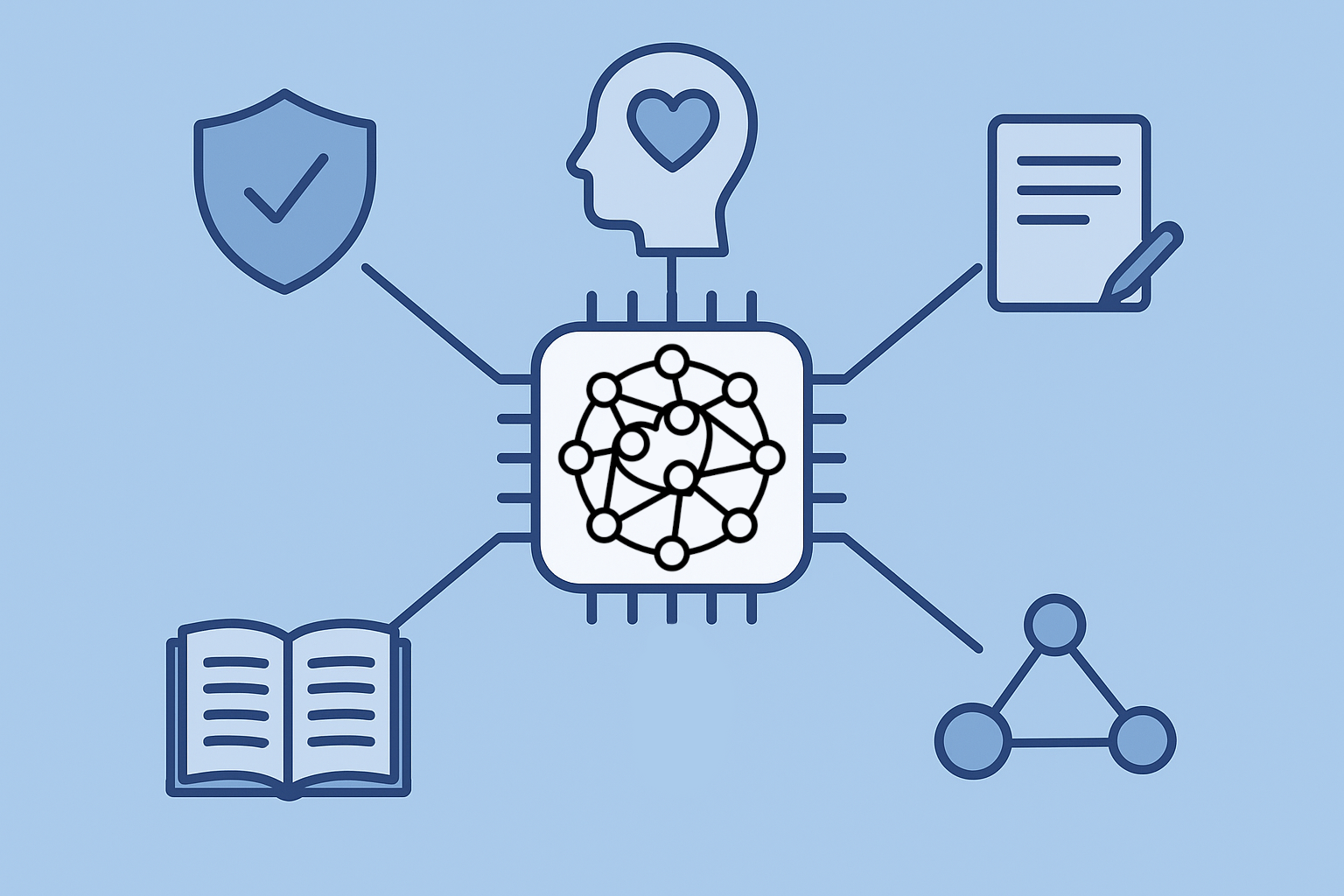

Die andere Seite

Solche Extremfälle kommen vor, sie sind aber dennoch äußerst selten. Gleichzeitig gibt es auch eine andere Seite der Nutzung von Sprachmodellen im Kontext von psychischen Erkrankungen: Studien, die Anzeichen darauf geben, dass Künstliche Intelligenz bei richtigem Einsatz Symptome psychischer Erkrankungen lindern kann. Eine Studie vom Dartmouth College mit der selbstentwickelten Anwendung "Therabot" aus dem Jahre 2025 zeigte, dass diagnostizierte Patient:innen mit Depressionen und Angststörungen durch die Nutzung der Applikation eine 51%ige Symptomreduktion für Depressionen und eine 31%ige Reduktion der Symptome von Angststörungen erreichten. Bei Anzeichen von kritischen Inhalten wie Suizidalität hat die Anwendung Sicherheitsmaßnahmen und eine Direktwahl zu einer Notfallhotline eingebaut.

Wichtig ist hier jedoch zu beachten, dass es sich um ein kontrolliertes Setting mit einer Anwendung handelte, die speziell für therapeutische Zwecke entwickelt wurde. Diese Menschen sind sich ihrer Erkrankung also bewusst und versuchen aktiv, diese zu behandeln. Das ist ein entscheidender Unterschied zu KI-Anwendungen, die einen allgemeinen Anwendungszweck haben (general purpose AI). Diese sind nicht auf therapeutische Interaktionen trainiert, sondern erfüllen viel eher den Zweck, die Nutzer:in an den Chatbot zu binden und das „Engagement“ zu erhöhen.

Was bedeutet das für die Praxis?

Für Fachkräfte heißt das vor allem: nicht dramatisieren, sondern beobachten. Machen Sie sich bewusst, dass fünf bis sechs Millionen Menschen in Deutschland Sprachmodelle täglich nutzen. Im Vergleich dazu sind die Fälle von KI-Psychose bundesweit selten.

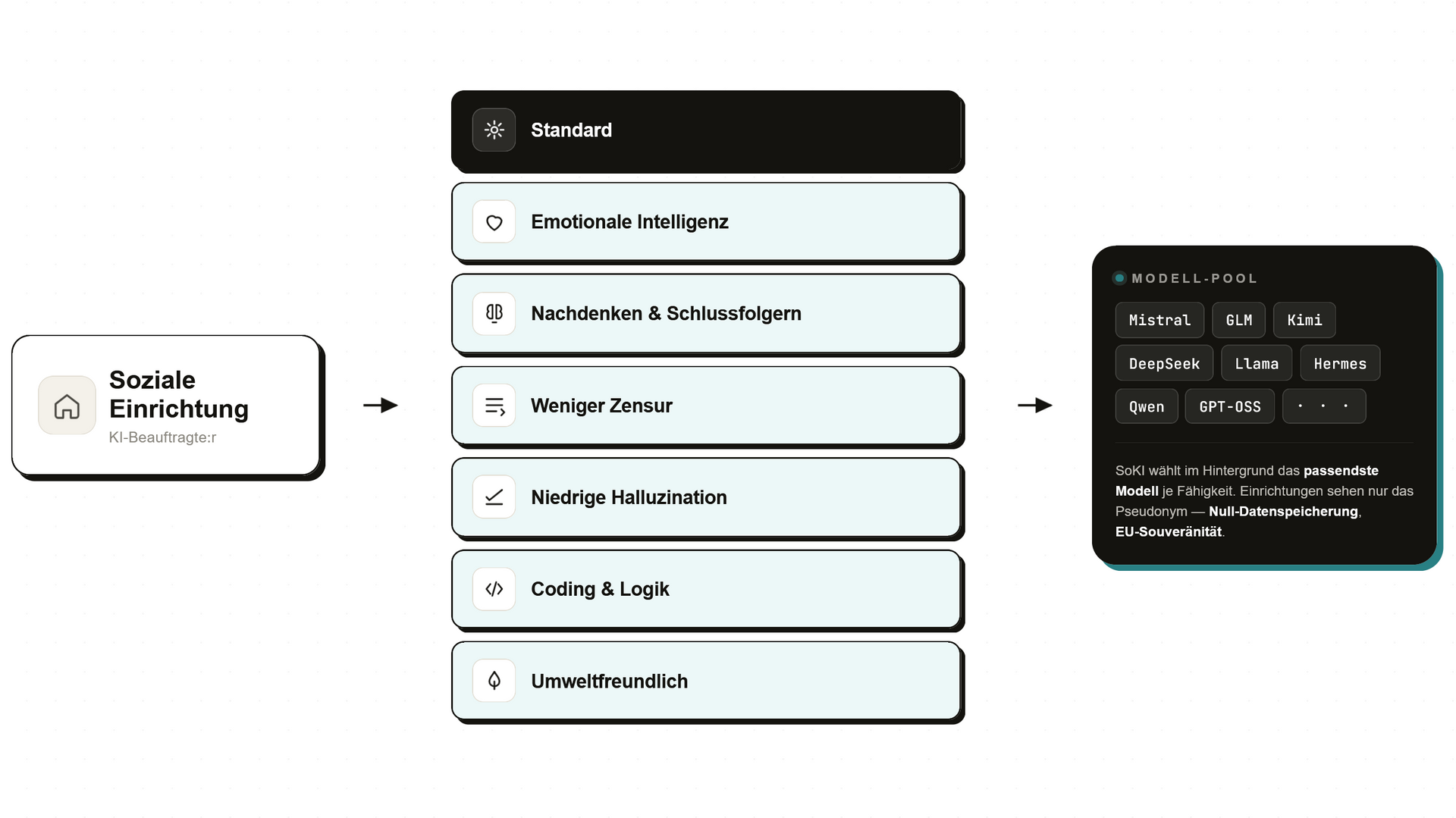

Sozial KI empfiehlt für Fachkräfte im sozialpsychiatrischen Bereich zwei Leitfragen: Wie ist die Person einzuschätzen? Persönlichkeit, Krankheitsbild und aktuelle Belastung bestimmen, ob KI-Nutzung eher entlastet oder Risiken birgt. Wie wird die KI genutzt? Häufige Erwähnungen, emotionale Aufladung der Beziehung oder Hinweise auf parasoziale Bindungen sind Warnsignale. Sollten Sie feststellen, dass eine Ihrer Klient:innen mit anfälligem Krankheitsbild eine parasoziale Beziehung zu einem Sprachmodell aufbaut, könnte eine präventive Intervention angebracht sein.

Ein wirksamer Ansatz könnte Entmystifizierung im Gespräch sein. Wer versteht, dass das Sprachmodell auf Wahrscheinlichkeiten basiert, keine Emotionen besitzt und keine Beziehung führt, könnte weniger anfällig für die Illusionswirkung sein. Hier handelt es sich jedoch um eine rein theoretische Einschätzung unsererseits, bisher gibt es noch keine belegte Therapiemethode gegen KI-assoziierte Psychosen.