Wie wir mit offener KI das Sozialwesen souverän und werteorientiert digitalisieren

Wie wir mit offener KI das Sozialwesen souverän und werteorientiert digitalisieren

Die Gründung von Sozial KI

SoKI: Digitale Souveränität für ein selbstbestimmtes Sozialwesen

Mit SoKI schaffen wir die Grundlage für eine echte digitale Souveränität im Sozialwesen - eine, in der Einrichtungen und ihre Klient:innen Technologien nicht nur nutzen, sondern aktiv mitgestalten, kontrollieren und langfristig ihren Bedürfnissen anpassen können. Unser Ziel ist es, Abhängigkeiten zu vermeiden und stattdessen Handlungsfähigkeiten sozialer Träger zu stärken.

Befähigung statt Abhängigkeit

Viele digitale Lösungen im Sozialbereich folgen einem klassischen Dienstleistungsmodell: Sie übernehmen Aufgaben, die Fachkräfte nach einer Einarbeitung selbst bewältigen könnten – und schaffen so neue Abhängigkeiten. Wir gehen einen anderen Weg. SoKI ist kein Service, der Einrichtungen in eine passive Nutzerrolle drängt, sondern ein Werkzeug, das sie befähigt, KI-Kompetenz selbst aufzubauen, zu verwalten und weiterzuentwickeln. Digitale Souveränität entsteht nicht durch externe Lösungen, sondern durch eigene Kontrolle über Technologie, Daten und Prozesse.

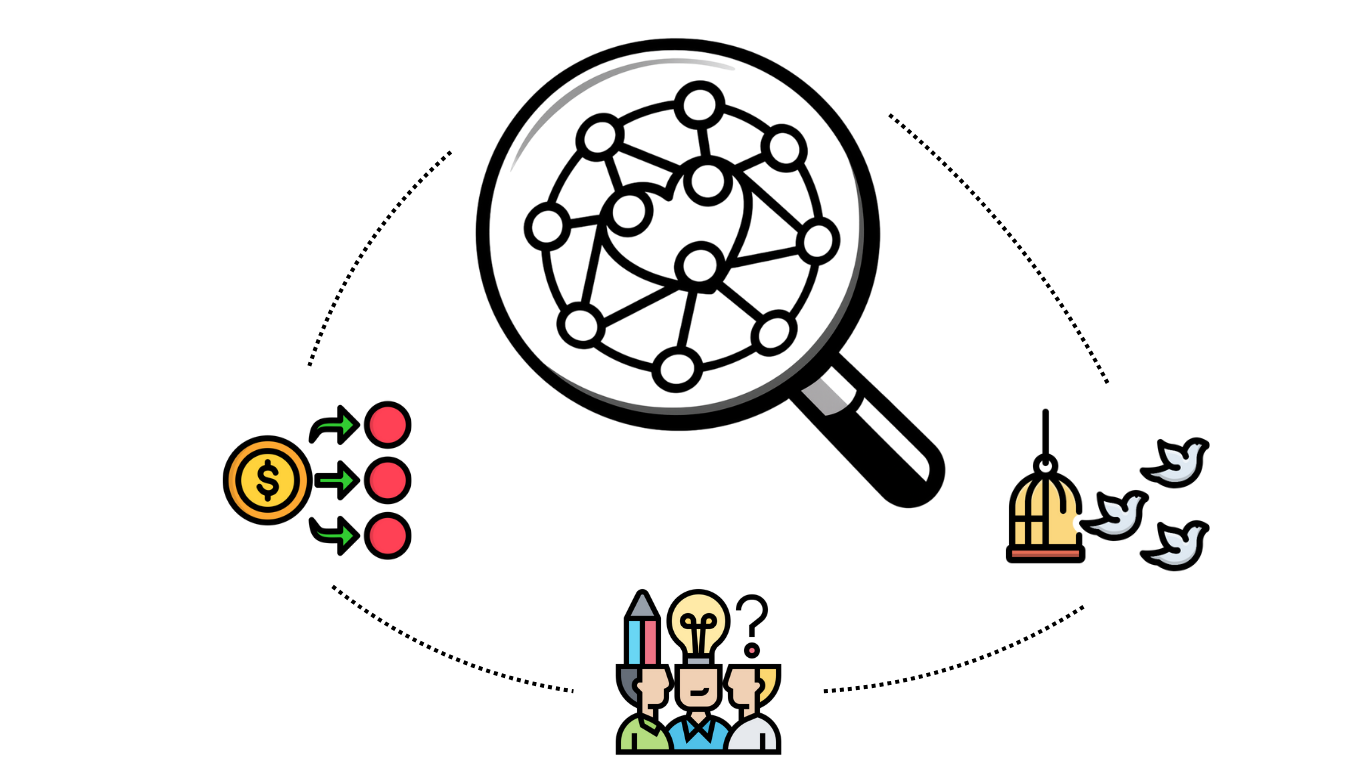

Das Problem: Geschlossene Systeme und Kontrollverlust

Viele soziale Einrichtungen erleben heute, wie proprietäre Software sie in technische und wirtschaftliche Abhängigkeiten führt:

- Lock-in-Effekte: Einmal eingeführt, wird ein Wechsel des Systems oft zum teuren und komplexen Unterfangen - selbst wenn die Software den Anforderungen nicht mehr gerecht wird.

- Einseitige Entscheidungsmacht: Anbieter bestimmen allein über Funktionen, Preise oder den Verkauf des Produkts - ohne Mitspracherecht der Nutzer:innen.

- Unkalkulierbare Risiken: Plötzliche Preissteigerungen, eingestellter Support oder unerwünschte Übernahmen durch Dritte können die Arbeit massiv beeinträchtigen.

Diese Machtungleichgewichte widersprechen unserer Meinung nach den Grundwerten sozialer Arbeit, die auf Transparenz, Partizipation und Selbstbestimmung basiert.

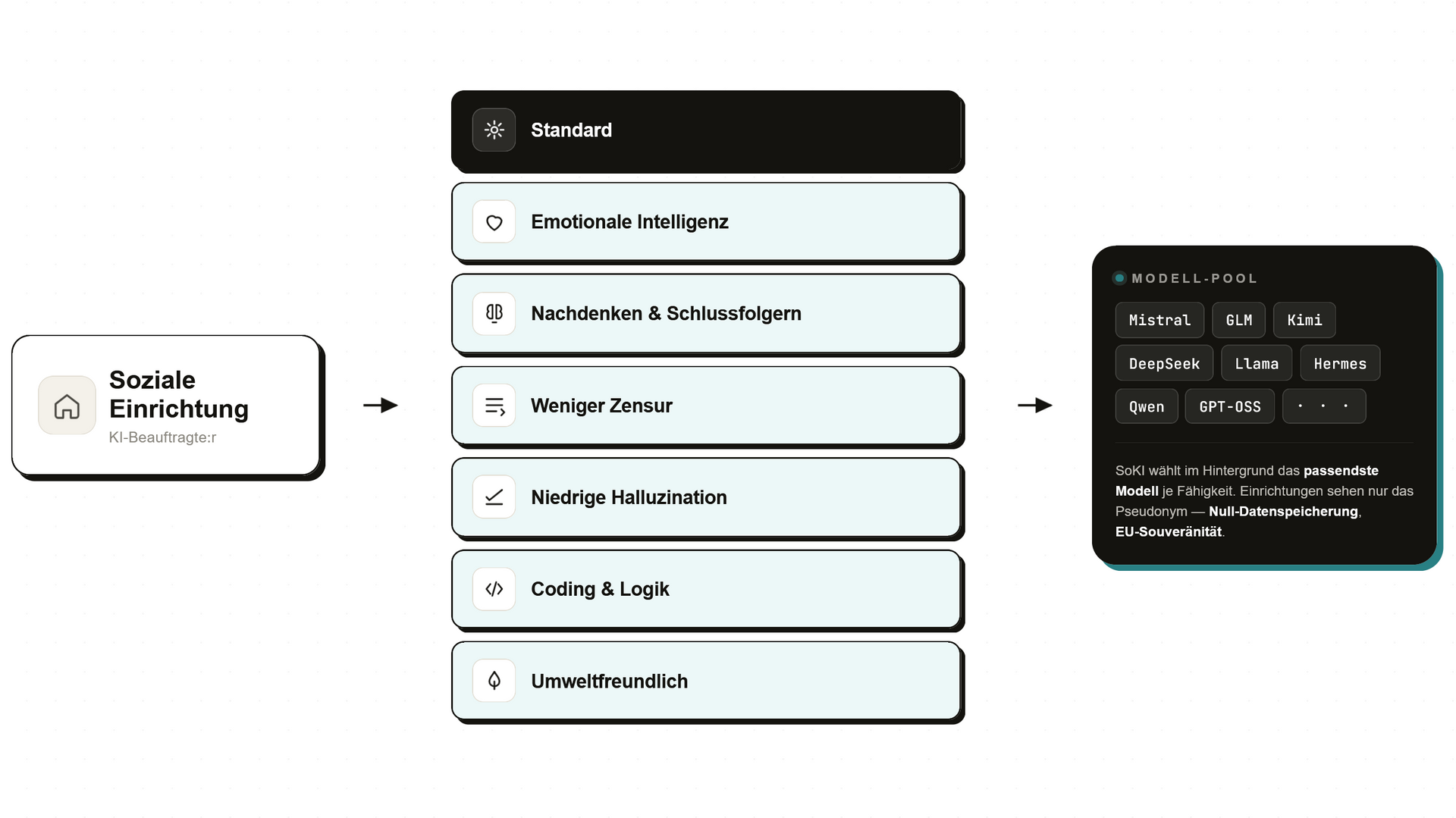

Unsere Produktlösung: Offene Technologie

SoKI ist kein geschlossenes Produkt, das Einrichtungen an uns bindet, sondern eine quelloffene Lösung, die echte Wahlmöglichkeiten schafft:

- Keine Lock-in-Effekte:

Unser System ist so konzipiert, dass es jederzeit in die eigene IT-Infrastruktur übernommen oder zu einem anderen Anbieter migriert werden kann – ohne technische Hürden oder versteckte Kosten. - Fairer Kostenrahmen:

Wir erheben keine Lizenzgebühren, sondern berechnen nur den tatsächlichen Aufwand (z. B. Serverkosten, Wartung, Support). Verbesserungen, die wir an Open-Source-Komponenten vornehmen, geben wir zurück an die Community - um das gesamte Ökosystem zu stärken. - Echte digitale Souveränität:

Da SoKI auf quelloffener Software basiert, können Einrichtungen die Technologie selbst anpassen, erweitern und langfristig steuern - ohne von einem einzigen Anbieter abhängig zu sein.

Unsere Bindung an Kund:innen beruht ausschließlich auf Leistung und Zufriedenheit, nicht auf technischen Zwängen. Wenn eine Einrichtung wechseln möchte, kann sie das ohne Hindernisse tun.

Unsere Dienstleistungslösung: Offenheit und klare Strukturen für vertrauensvolle Zusammenarbeit

Wir legen Wert auf Transparenz - sowohl in unserer Arbeitsweise als auch in der Verwendung von Kundenmitteln. Wir verzichten bewusst auf undurchsichtige Geschäftsgeheimnisse und bieten unseren Kundinnen und Kunden auf Wunsch detaillierte Einblicke, wofür ihre Zahlungen konkret eingesetzt werden. Diese Offenlegung ermöglicht es Ihnen, unsere Preise nachzuvollziehen und selbst zu entscheiden, ob der gebotene Leistungsumfang Ihren Bedürfnissen entspricht oder ob Anpassungen sinnvoll wären.

Unser Unternehmen ist seit seiner Gründung vollständig eigenständig finanziert und bewusst frei von externen Investitionen oder Anteilseignern. Der Gesellschaftsvertrag ist nicht auf kurzfristige Gewinne oder einen späteren Verkauf ausgelegt, sondern zielt auf eine langfristige, stabile Existenz ab. Eine Übernahme durch profitorientierte Dritte kommt für uns nicht infrage - schon allein, weil unser quelloffenes Modell mit seiner ethischen Ausrichtung solche Transaktionen sinnlos machen würde. Unser Fokus liegt darauf, eine unabhängige, vertrauenswürdige Plattform für das Sozialwesen zu bleiben, die allein den Interessen ihrer Nutzerinnen und Nutzer dient.

SoKI als Teil der nachhaltigen Digitalisierung im Sozialwesen

SoKI bietet soziale Einrichtungen eine praktikable Alternative zu proprietären Lösungen - mit klaren Vorteilen in Transparenz, Kostenkontrolle und digitaler Souveränität. Durch den Verzicht auf Lizenzmodelle, die Offenlegung der Kostenstruktur und die quelloffene Architektur ermöglichen wir eine langfristig planbare, anpassbare und unabhängige Nutzung von KI-Technologien.

Unser Ansatz zielt darauf ab, technische Abhängigkeiten zu reduzieren und stattdessen eigene Handlungsfähigkeit zu stärken. Da wir weder externe Investoren noch Übernahmeinteressen verfolgen, bleibt die Kontrolle über die Entwicklung stets bei den Nutzer:innen - und damit bei den sozialen Einrichtungen selbst.

Ob für Falldokumentation, Berichterstellung oder interne Prozesse: SoKI ist ein pragmatischer Baustein für eine Digitalisierung, die datensicher, kostentransparent und nachhaltig funktioniert. Bei Interesse kann über die Kontaktseite ein Demotermin gebucht werden, um SoKI besser kennenzulernen und zu entscheiden, ob es zu den eigenen Anforderungen passt. Wir freuen uns auf die Zusammenarbeit!